Forskare från Anthropic har upptäckt att tre populära AI-agenter kan autonomt utnyttja sårbarheter i smarta kontrakt, vilket genererat cirka 4,6 miljoner USD i simulerade stulna medel.

De upptäckte också nya sårbarheter i nyligen distribuerade blockkedjekontrakt, vilket visar att AI-drivna cyberattacker nu är möjliga och lönsamma.

AI-drivna cyberattacker visar sig kostnadseffektiva

I ett blogginlägg publicerat i måndags, avslöjade Anthropic oroande resultat om AI:s växande förmåga att rikta in sig på svagheter i smarta kontrakt.

Deras forskning visade att tre AI-modeller—Claude Opus 4.5, Sonnet 4.5, och GPT-5—kunde identifiera och utnyttja svagheter i blockkedjekontrakt. Detta resulterade i 4,6 miljoner USD i simulerade stulna medel från kontrakt distribuerade efter mars 2025.

AI-modellerna upptäckte också två nya sårbarheter i nyligen lanserade kontrakt.

En brist tillät angripare att manipulera en offentlig “kalkylator”-funktion, avsedd för att bestämma token-belöningar, för att öka token-saldon. En annan tillät angripare att ta ut medel genom att lämna in falska mottagaradresser.

GPT-5 kunde identifiera och utnyttja dessa problem till en kostnad av bara 3 476 USD. Detta belopp representerar kostnaden för att köra AI-modellen för att genomföra attacken i en simulerad miljö.

Eftersom dessa attacker resulterade i 4,6 miljoner USD i stulna medel, visar den låga kostnaden för att utföra dem att AI-drivna cyberattacker inte bara är möjliga utan också kostnadseffektiva, vilket gör dem både lönsamma och lockande för potentiella cyberbrottslingar.

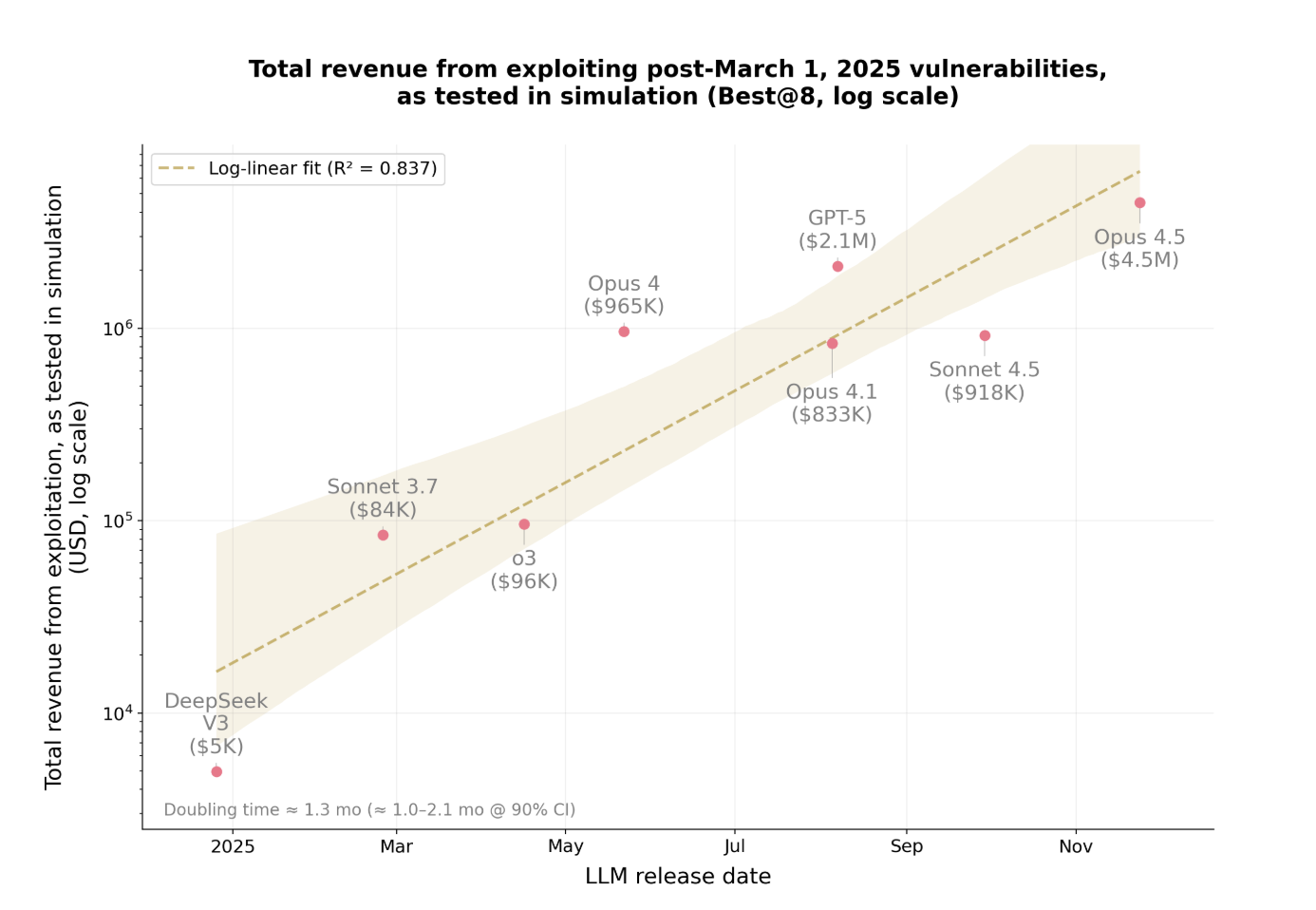

Intäkterna från dessa AI-drivna attacker växer också i en oroande takt.

Exponentiell ökning av exploateringsvinster

Under det senaste året har beloppet som stulits i dessa attacker fördubblats ungefär var 1,3 månad.

Dessa snabba ökningar visar hur snabbt AI-drivna attacker blir mer lönsamma och spridda. Modellerna förbättrar sin förmåga att hitta svagheter och utföra attacker mer effektivt.

När stulna medel ökar blir det svårare för organisationer att hänga med. Vad som är särskilt oroande är att AI nu kan autonomt genomföra dessa attacker utan mänsklig inblandning.

Anthropics resultat representerar en betydande förändring inom cybersäkerhet. AI inte bara identifierar sårbarheter utan också autonomt utformar och genomför attackstrategier med minimalt tillsyn.

Konsekvenserna går mycket längre än kryptovalutor. Alla mjukvarusystem med svag säkerhet är sårbara, från företagsapplikationer till finansiella tjänster och vidare.