ChatGPT och Googles Gemini har blivit ledande inom utvecklingen av stora språkmodeller. Dessa plattformar har förändrat AI-industrin. Men hur de samlar in information och hanterar dataset har varit en ständig etisk fråga.

BeInCrypto pratade med nya AI-projekt inom Web3, inklusive ChainGPT, Space ID, Sapien.io, Vanar Chain, O.XYZ, AR.IO och Kindred, för att diskutera aktuella frågor om immateriella rättigheter, upphovsrätt och ägande. En viktig insikt var potentialen hos decentraliserad artificiell intelligens (deAI) som ett värdefullt alternativ.

LLM:ernas uppgång och dilemmat med dataförvärv

Sedan deras skapelse har stora språkmodeller (LLM) snabbt blivit allmänt använda. Plattformar som OpenAI:s ChatGPT och Googles Gemini var många människors första kontakt med artificiell intelligens (AI) och dess potential.

Men dessa företag har också granskats för sina verksamheter. För att förbli konkurrenskraftiga behöver AI-modeller tillgång till många dataset. LLM kan bara generera mänskliga svar och förstå komplexa frågor genom att bearbeta stora mängder text.

För att göra detta samlar ledande teknikjättar som OpenAI, Google, Meta, Microsoft, Anthropic och Nvidia in all tillgänglig data och information på internet för att träna sina AI-modeller. Detta har väckt allvarliga frågor om vem som äger den input som dessa plattformar använder och senare återger som output.

Trots AI:s omvälvande potential har frågor om immateriella rättigheter lett till hårt omstridda rättsliga strider.

Bygger AI-företag imperier på stulet innehåll?

Snabb AI-användning har väckt oro kring dataägande, integritet och möjliga upphovsrättsintrång. En viktig fråga är användningen av upphovsrättsskyddat material för att träna centraliserade AI-modeller som stora företag kontrollerar.

“AI-företag bygger imperier på kreatörers arbete utan att be om tillåtelse eller dela vinsterna. Författare, konstnärer och musiker har spenderat år på att fullända sitt hantverk, bara för att se sitt arbete användas av AI-modeller som skapar kopior på några sekunder,” sa Jawad Ashraf, VD för Vanar Chain, till BeInCrypto.

Denna fråga har verkligen orsakat stor missnöje. Vanar Chains VD tillade att OpenAI och andra öppet har erkänt att de samlat in upphovsrättsskyddat material, vilket har lett till stämningar och en bredare diskussion om dataetik.

“Kärnan i problemet är ersättning—AI-företag hävdar att insamling av offentligt tillgänglig data är rättvist, medan kreatörer ser det som stöld i dagsljus,” sa Ashraf.

Definiera gränserna för AI-genererat arbete

The New York Times lämnade in en stämning mot OpenAI och Microsoft i december 2023, med anklagelser om upphovsrättsbrott och obehörig användning av dess immateriella egendom.

The Times anklagade Microsoft och OpenAI för att ha skapat en affärsmodell baserad på “olaglig kopiering och användning av The Times unikt värdefulla verk.” Tidningen hävdade också att dessa modeller “utnyttjar och, i många fall, behåller stora delar av det upphovsrättsskyddade uttrycket i dessa verk.”

Fyra månader senare stämde åtta fler nyhetsutgivare i sex olika amerikanska delstater Microsoft och OpenAI för upphovsrättsintrång.

The Chicago Tribune, The Denver Post, The Mercury News i Kalifornien, New York Daily News, The Orange County Register i Kalifornien, Orlando Sentinel, Pioneer Press i Minnesota och Sun Sentinel i Florida – alla anklagade de två teknikföretagen för att ha använt deras artiklar utan tillstånd i AI-produkter och tillskrivit dem felaktig information.

“Domstolar tvingas nu besvara frågor som inte fanns för några år sedan: Utgör AI-genererat innehåll ett derivatverk? Kan upphovsrättsinnehavare kräva skadestånd när deras data används utan samtycke?” sa Trevor Koverko, medgrundare av Sapien.io, till BeInCrypto.

Förutom journalistiska organisationer har förlag, författare, musiker och andra innehållsskapare inlett rättsliga åtgärder mot dessa teknikföretag för upphovsrättsskyddad information.

Rättsliga Strider Inom Olika Branscher

Bara förra veckan meddelade tre branschorganisationer att de kommer att stämma Meta i en domstol i Paris, med anklagelser om att Meta “massivt använde upphovsrättsskyddade verk utan tillstånd” för att träna sina generativa AI-drivna chattbotar, som används på Facebook, Instagram och WhatsApp.

Samtidigt stämde de visuella konstnärerna Sarah Andersen, Kelly McKernan och Karla Ortiz AI-konstgeneratorer Stability AI, DeviantArt och Midjourney för att ha använt deras verk för att träna sina AI-modeller.

“Det finns ingen ände på oron när det gäller oreglerad användning av data och kreativt material av centraliserade AI-företag. För närvarande kan vilken konstnär, författare eller musiker som helst med offentligt tillgängligt material få sitt arbete genomsökt av AI-algoritmer som lär sig att skapa nästan identiskt innehåll—och tjäna pengar på det medan konstnären inte får något,” argumenterade Phil Mataras, grundare av AR.IO.

OpenAI och Google hävdar att om lagstiftning begränsar deras tillgång till upphovsrättsskyddat material, kommer USA att förlora AI-kapplöpningen mot Kina. Enligt dem arbetar företag i Kina med färre regleringar, vilket ger deras konkurrenter en viktig fördel.

Dessa jättar lobbar aggressivt för att USA ska klassificera AI-träning på upphovsrättsskyddad data som “fair use.” De menar att AI:s bearbetning av upphovsrättsskyddat innehåll resulterar i nya resultat som är fundamentalt olika från källmaterialet.

Men när generativa AI-verktyg alltmer producerar text, bilder och röster, driver många branscher rättsliga utmaningar mot dessa företag.

“Innehållsskapare—oavsett om de är författare, musiker eller mjukvaruutvecklare—säger ofta att deras [intellektuella egendom] används på sätt som går utöver fair use, särskilt när AI-system kopierar eller replikerar aspekter av deras originalverk,” sa Ahmad Shadid, grundare och VD för O.XYZ.

Samtidigt lobbar aktörer inom Web3 för ett alternativ till traditionella företags tillvägagångssätt för LLM-utveckling.

DeAI dyker upp som Web3-alternativet

Decentraliserad AI (deAI) är ett framväxande område inom Web3 som utforskar användningen av blockchain och distribuerad liggande teknologi för att skapa mer demokratiska och transparenta AI-system.

“DeAI, som utnyttjar blockchain och distribuerad liggande teknologi, syftar till att hantera frågor om dataägande och upphovsrätt genom att skapa mer transparenta AI-system. Det fördelar utvecklingen och kontrollen av AI-modeller över ett globalt nätverk, vilket etablerar rättvisare modeller för AI-träning som respekterar innehållsskaparnas rättigheter. DeAI syftar också till att tillhandahålla mekanismer för rättvis ersättning till skapare vars arbete används i AI-träning, vilket potentiellt löser många av de problem som är förknippade med centraliserade AI-modeller,” förklarade Max Giammario, VD och grundare av Kindred.

Med AI:s växande globala betydelse lovar dess sammansmältning med blockchain att förändra båda sektorerna, vilket skapar nya möjligheter för kryptoinnovation och investeringar.

Som svar har aktörer i branschen redan börjat utveckla framgångsrika projekt som kombinerar AI och Web3-teknologier.

Till skillnad från företag som producerar centraliserade AI-modeller, syftar deAI till att vara helt öppen källkod.

OpenAI har tidigare hävdat att det följer den amerikanska fair use-doktrinen trots att det använder upphovsrättsskyddat material för att träna sina AI-modeller. Dessutom är ChatGPT, dess mest populära applikation, helt gratis att använda.

Harrison Seletsky, chef för affärsutveckling på Space ID, påpekade en motsägelse i OpenAI:s argument.

“Det tydliga etiska problemet är att material används utan skaparnas uttryckliga tillstånd. Om de är upphovsrättsskyddade måste tillstånd ges, och vanligtvis betalas en avgift. Men bortom det, även om LLM:er som ChatGPT använder öppen källkod, är OpenAI:s modeller inte öppen källkod. De använder offentligt tillgängligt material utan att fullt ut ‘ge tillbaka’ till de källor de hämtar från.

Det finns en övergripande fråga här om AI bör vara öppen källkod. OpenAI:s ChatGPT är det inte, medan modeller som Kinas DeepSeek är det, liksom decentraliserad AI. Ur ett etiskt och immaterialrättsligt perspektiv är det senare definitivt ett bättre val,” sa Seletsky.

Dessa teknologiska jättars centraliserade kontroll väcker också andra frågor om implementeringen och övervakningen av AI-modeller.

Centraliserad vs. Decentraliserad: Etiska och Operativa Skillnader

Till skillnad från deAI:s gemenskapsdrivna natur, byggs centraliserade AI-modeller av ett fåtal personer, vilket leder till potentiella fördomar.

“Centraliserad AI fungerar vanligtvis under ett enda företags paraply, där beslut drivs av ett toppstyrt vinstmotiv. Det är i huvudsak en svart låda ägd och förvaltad av en enhet. I kontrast förlitar sig DeAI på en gemenskapsdriven strategi. AI:n är utformad för att analysera gemenskapsfeedback och optimera för kollektiva intressen istället för bara företagsintressen,” förklarade Ahmad Shadid, grundare och VD för O.XYZ.

Samtidigt ger blockchain-teknologi en tydlig väg för intäktsgenerering.

“Skapare kan tokenisera sina kreativa tillgångar—som artiklar, musik eller till och med idéer—och sätta sina egna priser. Detta skapar en rättvisare miljö för både skapare och användare av immateriell egendom, vilket i huvudsak bildar en fri marknad för IP. Det gör också ägande lätt att bevisa, eftersom allt på blockchain är transparent och oföränderligt, vilket gör det mycket svårare för andra att utnyttja någons arbete utan att korrekt justera incitamenten,” sa Seletsky till BeInCrypto.

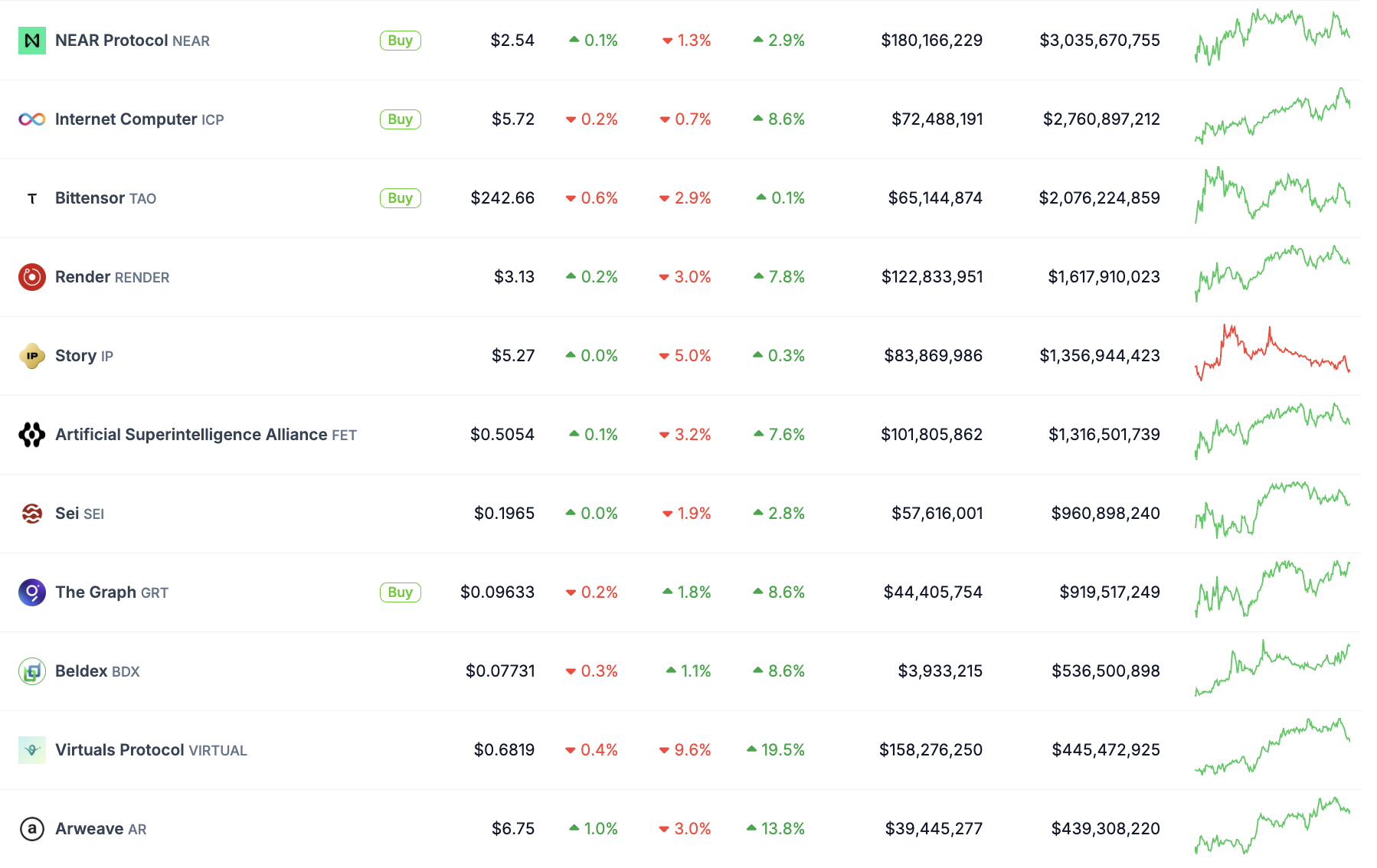

Olika Web3-utvecklare har redan utvecklat projekt som decentraliserar innehåll som används för generativ AI. Plattformar som Story, Inflectiv och Arweave utnyttjar olika aspekter av blockchain-teknologi för att säkerställa att dataset som används för AI-modeller är etiskt kuraterade.

Ilan Rakhmanov, grundare av ChainGPT, ser deAI som en viktig motkraft till centraliserad AI. Han hävdar att det kommer att vara avgörande att hantera de oetiska metoderna hos befintliga AI-monopol för att odla en hälsosammare industri i framtiden.

“Detta skapar ett farligt prejudikat där AI-företag kan använda upphovsrättsskyddat innehåll utan korrekt erkännande eller betalning. Juridiskt sett bjuder detta in till regleringsgranskning; etiskt sett berövar det skapare kontroll. ChainGPT tror på on-chain-erkännande och monetisering, vilket säkerställer ett rättvist värdeutbyte mellan AI-användare, bidragsgivare och modelltränare,” sa Rakhmanov.

Men för att DeAI ska ta plats i centrum måste det först övervinna flera hinder.

Vilka hinder möter deAI?

Även om deAI har blomstrande potential, är det också i sina tidiga stadier. I det avseendet har företag som OpenAI och Google övertaget när det gäller ekonomisk styrka och infrastruktur. De har medel att hantera de stora resurser som behövs för att samla in så stora mängder data.

“Centraliserade AI-företag har tillgång till enorm datorkraft, medan deAI behöver effektiva, distribuerade nätverk för att skala. Sedan finns det data—centraliserade modeller frodas på samlade dataset, medan deAI måste bygga pålitliga pipelines för att samla in, verifiera och kompensera bidragsgivare rättvist,” sa Koverko till BeInCrypto.

Ahmad Shadid tillade:

“Att bygga och driva AI-system på distribuerade liggare kan vara komplicerat, särskilt om du försöker hantera stora mängder data i skala. Det kräver också noggrann övervakning för att hålla AI:s inlärningsprocesser i linje med samhällets etik och mål.”

Dessa teknologiska jättar kan också använda sina resurser och kontakter för att lobba hårt mot konkurrenter som deAI.

“De kan göra det genom att förespråka regleringar som gynnar centraliserade modeller, utnyttja deras marknadsdominans för att begränsa konkurrensen eller kontrollera viktiga resurser som är nödvändiga för AI-utveckling,” sa Giammario.

För Ashraf bör sannolikheten för att detta händer tas för given.

“När hela din affärsmodell bygger på att samla data och tjäna pengar på det i hemlighet, är det sista du vill ha ett öppet, transparent alternativ. Förvänta dig att AI-jättar lobbar mot DeAI, driver på för restriktiva regleringar och använder sina stora resurser för att misskreditera decentraliserade alternativ. Men internet började själv som ett decentraliserat system innan företag tog över, och folk vaknar upp till nackdelarna med centraliserad kontroll. Kampen för öppen AI har bara börjat,” förutspådde Jawad Ashraf, VD för Vanar Chain.

För att främja sitt uppdrag behöver deAI dock öka sin medvetenhet hos allmänheten, nå både Web3-användare och de utanför området.

Överbrygga kunskapsklyftan

När Seletsky från Space ID tillfrågades om de största hindren som deAI för närvarande står inför, sa han att folk behöver vara medvetna om problemet med upphovsrättsintrång i AI-modeller för att lösa det.

“Det största hindret är brist på utbildning. De flesta användare vet inte var datan kommer ifrån, hur den analyseras och vem som kontrollerar den. Många inser inte ens att AI har fördomar, precis som människor. Det finns ett behov av att utbilda den genomsnittliga personen om detta innan de kan förstå fördelarna med decentraliserade AI-modeller,” sa han.

När allmänheten förstår upphovsrättsproblemen inom centraliserade AI-modeller, måste deAI-förespråkare aktivt visa deAI:s fördelar som ett starkt alternativ. Trots ökad medvetenhet står deAI fortfarande inför adoptionsutmaningar.

“Adoption är en annan utmaning. Företag är vana vid färdiga AI-lösningar, och deAI måste matcha den nivån av tillgänglighet samtidigt som det bevisar sina fördelar i säkerhet, transparens och innovation,” sa Koverko.

Vägen Framåt: Tydliga Regler och Allmänhetens Förtroende

Med utmaningarna inom utbildning och tillgänglighet adresserade, beror vägen till bredare deAI-adoption på att etablera regleringsklarhet och bygga allmänhetens förtroende. Trevor Koverko, medgrundare av Sapien.io, tillade också att deAI behöver medföljande regleringsklarhet för att nå dessa mål.

“Utan klara ramar riskerar deAI-projekt att hamna i skymundan på grund av juridisk osäkerhet medan centraliserade aktörer driver på för policyer som gynnar deras dominans. Att övervinna dessa utmaningar innebär att förfina vår teknik, bevisa verkligt värde och bygga en rörelse som driver på för öppen, demokratiserad AI,” hävdade han.

Shadid höll med om behovet av större institutionellt stöd och tillade att det bör kombineras med att bygga större allmänhetens förtroende.

“Transparens kan vara oroande om du har spenderat årtionden på att fullända proprietära metoder, så DeAI måste bevisa sin överlägsenhet i termer av förtroende och innovation. En annan utmaning är att bygga tillräckligt med användarförtroende och regleringsklarhet så att människor—och till och med regeringar—känner sig bekväma med hur data hanteras. Det bästa sättet att få genomslag är att visa verkliga användningsfall där decentraliserad AI tydligt överträffar sina centraliserade motsvarigheter eller åtminstone bevisar att den kan matcha dem i hastighet, kostnad och kvalitet samtidigt som den är mycket mer öppen och rättvis,” förklarade Ahmad Shadid.

Slutligen kräver upphovsrättsfrågorna kring AI-modeller ett paradigmskifte, med fokus på att respektera immateriella rättigheter och främja ett mer demokratiskt AI-ekosystem—oavsett deAI:s slutliga påverkan.