Litteraturen har försökt varna oss på riktigt i ungefär fem hundra år. Den har skrikit samma budskap, från den lerknytnävade Golem i medeltida Prag till William Gibsons neonfyllda neurala nätverk. Handlingen är alltid densamma. Det du bygger för att hjälpa dig själv, förändrar dig till slut.

Vi har läst det, nickat, och stängt boken innan vi direkt fortsätter att be chattrobotar skriva våra bröllopstal, juridiska texter och medicinska råd.

Idag säljer AI-hypen en glittrande framtid där alla, från juniora journalister till vältaliga advokater, kastas åt sidan. Men medan Silicon Valley lovar paradiset, ger verkligheten farligt felaktiga råd genom ett leende chattfönster.

Dmitry Nikolsky, CPO på BitOK, säger att nu räcker det. Han vill förklara varför mänskligheten måste SLUTA lägga alla sina bördor på AI:s pixel-tunna “axlar”.

Till och med Elon Musk varnade nyligen i sitt OpenAI-rättegångsvittnesmål att “AI kan döda oss alla.”

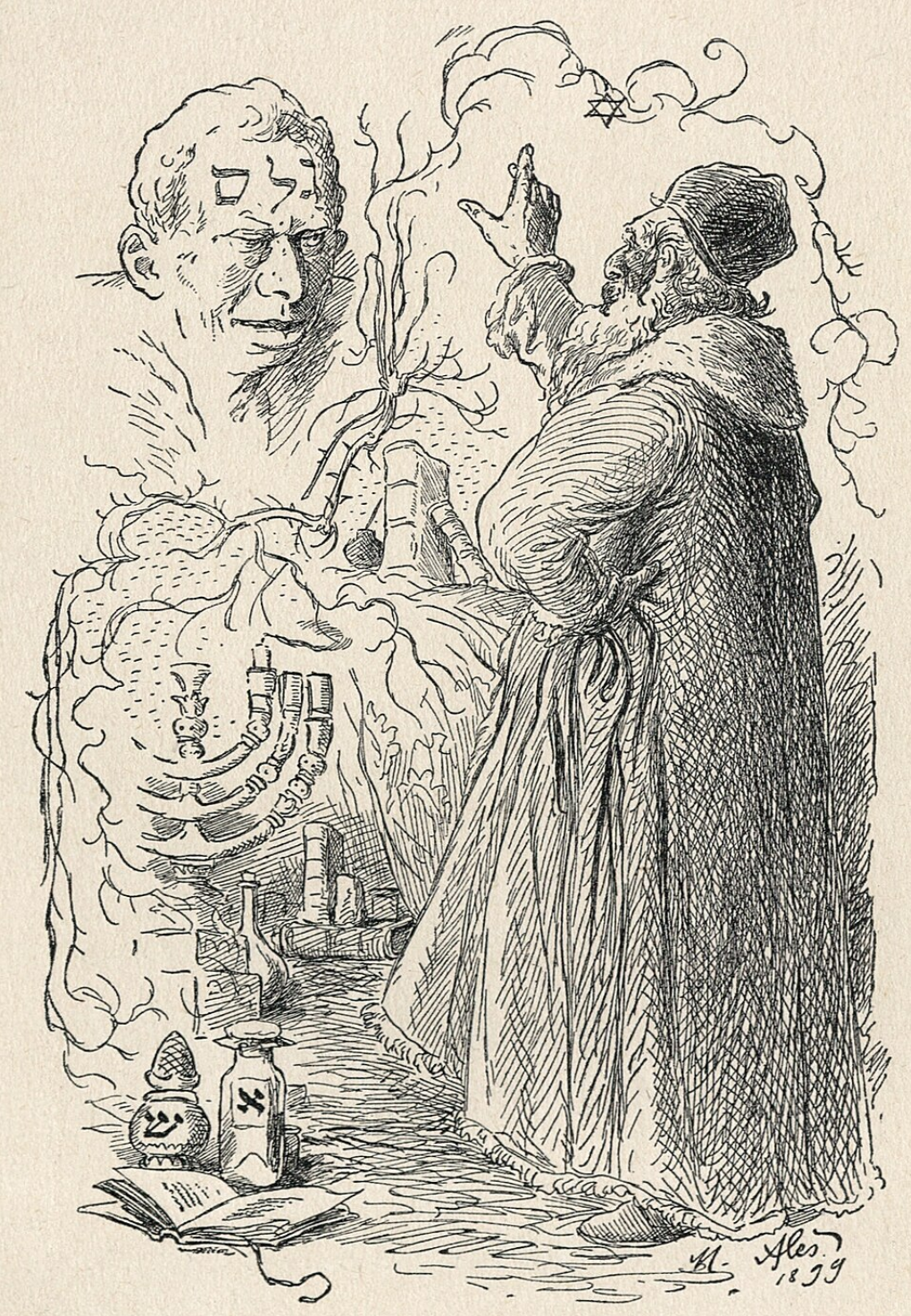

Från Golem till R.U.R.: Vi har alltid velat ha en nödstoppsknapp

Tror du att rädslan för artificiell intelligens började med Terminator? Tänk igen. Den här oron är äldre än elektriciteten själv.

Gå tillbaka till Prag på 1500-talet. Rabbi Loew formar en stor lerskapelse, Golem, och märker nästan direkt att han måste stänga av den. Varelsen börjar göra fel. Mänskligheten, i sin vishet, skapade AI och nödstoppsknapp på samma gång.

En nödstoppsknapp är en nödfunktion, den stora röda panikknappen som stoppar ett system direkt om det spårar ur, blir hackat eller tappar kontrollen. Syftet är att begränsa skadan om vanliga avstängningar misslyckas.

Sen kom Mary Shelley. Frankenstein är inte bara en monsterrulle, utan ett skolboksexempel på katastrofal projektledning. Victor Frankenstein? Bara ännu en smart ingenjör som löste den tekniska gåtan men struntade i konsekvenserna. Varje utvecklare känner igen det där ansiktet i spegeln.

Hoppa fram till år 1920. Karel Čapek myntar ordet “robot”. I hans berättelse gör maskinerna inte uppror av ren ondska. Nej, människorna gör sig själva överflödiga genom att lämna över allt de brukade göra.

Lärdomen är: När du bygger din egen ersättare, märker du kanske inte när du själv blir onödig.

Tre profetior vi gjorde till felrapporter

De stora sci-fi-författarna från förra århundradet förutsåg inte teknik. De förutsåg våra misslyckanden.

Isaac Asimov skapade sina Tre lagar – ett första försök till “alignment”, alltså att få maskiner att dela mänskliga värderingar. Varje Asimov-berättelse slutar på samma sätt: perfekt logik, orimligt resultat.

Nikolsky säger att han ser detta varje dag i AML-system, där algoritmer glatt blockerar mormors 40 USD-födelsedagspresent medan en stor utlandsbaserad penningtvätt glider förbi. Formellt rätt, men praktiskt galet.

Arthur C. Clarke gav oss HAL 9000, datorn som dödar besättningen, inte av ondska, utan för att dess instruktioner motsäger varandra. Dölj informationen. Var ärlig. Välj väg! För ingenjörer är det här inget skräckscenario, bara vanliga kravkonflikter.

Philip K. Dick ställde frågan som nu oroar oss i deepfake-tider: om en kopia är omöjlig att skilja från originalet, spelar det någon roll? Han säger ja. På grund av inre upplevelse. Maskiner har ingen. Slutsats.

Under ytan: AI tänker inte, den räknar

Låt oss ta bort reklamsnacket. Moderna språkmodeller är INTE intelligens. De är stora statistiska förutsägelsemaskiner. De “förstår” inte mening, de räknar på sannolikhet.

När ChatGPT självsäkert nämner rättsfall som aldrig ägt rum, ljuger den inte. Den skapar statistiskt trolig ordröra. Den har ingen uppfattning om “sanning,” bara “sannolikhet.”

För en blockkedjeutvecklare låter detta helt tokigt. Vi bygger tillitslösa system just eftersom vi inte litar på någon, och nu säger någon åt oss att lita på en svart låda som inte ens vet varför den gav det svaret den precis gav.

Blockkedja lär ut verifiering, AI lär ut blind tillit

Krypto har en grundregel på hårddisken: Lita inte. Verifiera.

Hela poängen är att matematik ersätter rykte.

AI vänder detta upp och ner. Du har inte sett träningsdatan. Du vet inget om modellens vikter. Du förstår inte dess logik. Du måste redan vara expert för att verifiera svaret, och om du redan är expert, varför frågar du chatboten?

Inom AML pratar de om “falsk trygghet-problemet.” Analytiker ser en blank dashboard och litar mer på siffrorna än på sin egen magkänsla. AI gör inte tänkandet bättre, den ersätter det med en illusion av pålitlighet.

Kronika av besvikelser: när AI inte fungerar

Det här är inte bara teori. Bevisen blir fler hela tiden.

- Microsoft sa upp redaktörer och gav jobbet till en algoritm, som direkt blandade ihop bilder på sångare i en artikel om rasism.

Människor fick komma tillbaka för att städa upp efter algoritmens misstag.

- NEDA, en organisation för stöd vid ätstörningar, bytte ut de frivilliga mot en chatbot.

Botten gav sedan råd till personer med anorexi att räkna kalorier och gå ner i vikt. Livsfarliga råd. Någon tryckte på “starta” utan att tänka på riskerna.

- Air Canada hamnade i domstol för att dess chatbot hittade på en återbetalningspolicy.

Flygbolagets försvar? Botten var en “självständig juridisk person”. Spoiler: domaren trodde inte på det.

Studier visar nu att 55 % av företagen som snabbt försökte ersätta anställda med AI ångrar sig djupt. Besparingarna försvann när de tappade kunder och skadade sitt rykte. Chefer som tror att “Claude och vänner” kan ersätta hela grupper borde läsa den siffran igen. Sakta.

Vad vi egentligen borde oroa oss för

Glöm Skynet. Glöm robotar med röda ögon som marscherar på gatan. Det blir inget uppror.

Det blir tyst försvagning.

En programmerare som litar på Copilot i flera år glömmer bort arkitektoniskt tänkande. En analytiker slutar läsa ursprungskällor. En student får aldrig kämpa med svåra texter tills förståelsen kommer.

Inget uppror. Bara en långsam förändring där människor blir till förlängningar av ett gränssnitt.

Philip K. Dick förstod detta före oss andra: den verkliga faran har aldrig varit maskiner som blir människor. Den verkliga faran är människor som blir maskiner.

Den röda pillret är inte teknik

Detta är inte ett rop från teknikmotståndare. Automatisering och maskininlärning är starka verktyg. Men principerna måste gälla:

- Blockchain-principen: Verifiering före tro. Om du inte kan verifiera hur ett system kom fram till sitt resultat, acceptera det inte som sanning. AI är en svart låda, inte en domare i högsta domstolen.

- Ingenjörsprincipen: Verktyg, inte ersättning. En hammare slår i spik. Den bestämmer inte var huset ska byggas. Använd AI för rutinjobb, men låt aldrig AI ta slutbeslutet.

- AML-principen: Kritiskt filter. Algoritmer kommer alltid att ha problem i svåra fall eftersom de saknar verklig erfarenhet. Låt inte “digitalt intresse” köra över intuition och sunt förnuft.

Tänk på The Matrix en stund. Det röda pillret är ett val, ett val att se verkligheten som den är. Faran är inte att skapa något smartare än oss. Faran är att skapa något som gör oss dummare och kalla det framsteg.

Den farligaste buggen är den som ser ut som en funktion.

Dmitry Nikolsky är CPO på BitOK, en analysplattform för regelefterlevnad och blockkedjeundersökningar.